Claude Code: quando o problema não está no modelo, mas no sistema ao redor dele Link para o cabeçalho

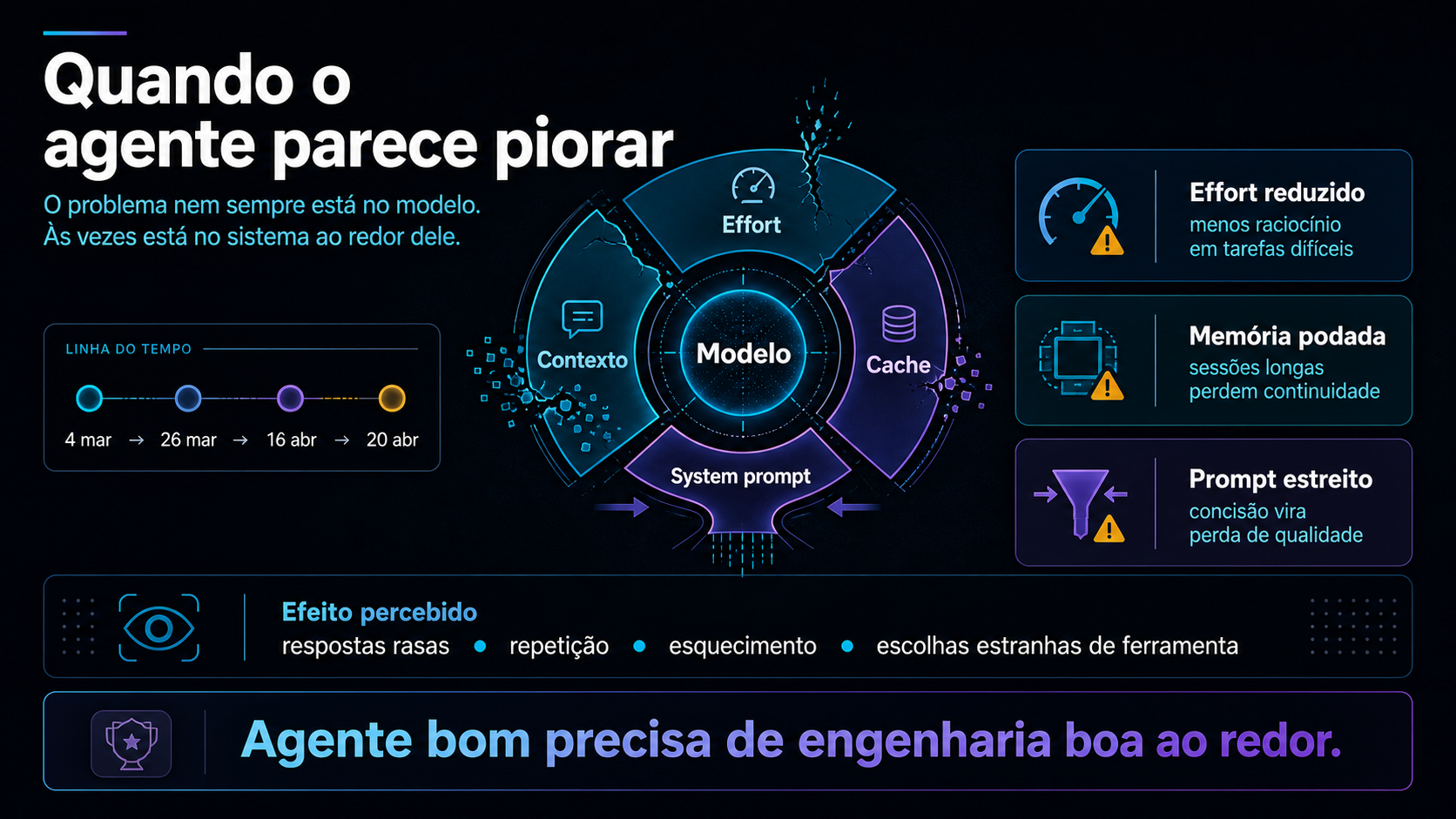

Em abril de 2026, a Anthropic publicou um postmortem raro sobre uma sensação que vinha crescendo entre usuários de Claude Code: para algumas pessoas, o agente simplesmente parecia ter piorado. Não era uma reclamação abstrata do tipo “o modelo está menos inteligente”. Eram relatos de respostas mais fracas, repetição, esquecimento de contexto, escolhas estranhas de ferramentas e uma impressão geral de que o produto tinha perdido parte da confiança operacional.

O ponto interessante é que a própria Anthropic investigou e chegou a uma conclusão mais sofisticada do que a explicação fácil. Segundo a empresa, a API e a camada de inferência não foram afetadas. O problema estava em três mudanças separadas no produto Claude Code, no Claude Agent SDK e no Claude Cowork: uma alteração no esforço de raciocínio padrão, um bug de cache/contexto que descartava histórico de raciocínio e uma mudança de system prompt que tentava reduzir verbosidade, mas também reduziu qualidade em tarefas de programação.

Esse caso é um bom retrato do momento atual dos agentes de código. A qualidade percebida não depende apenas do modelo. Depende do modelo, claro, mas também do harness, do prompt de sistema, da janela de contexto, das políticas de cache, da forma como comandos são executados, da observabilidade, do rollout, da comunicação com usuários e da engenharia de produto que envolve tudo isso.

Em outras palavras: um agente de programação não é um modelo com uma interface bonita. Ele é um sistema distribuído de decisões pequenas. E quando algumas dessas decisões escorregam ao mesmo tempo, o usuário sente como se a inteligência tivesse evaporado.

O que aconteceu com o Claude Code Link para o cabeçalho

O relato oficial da Anthropic, publicado em 23 de abril de 2026, aponta três causas principais para os problemas recentes de qualidade.

A primeira aconteceu em 4 de março de 2026. A Anthropic mudou o esforço de raciocínio padrão do Claude Code de high para medium. A motivação era reduzir latência, consumo de tokens e situações em que a interface parecia travada quando o modelo pensava por muito tempo. Faz sentido como intenção de produto: se uma ferramenta parece congelada, usuários perdem confiança. Mas, na prática, a troca cortou justamente uma parte do comportamento que muitos usuários valorizavam: mais tempo de raciocínio para tarefas difíceis. A empresa reverteu a decisão em 7 de abril.

A segunda aconteceu em 26 de março de 2026. A Anthropic lançou uma otimização para limpar raciocínios antigos de sessões que tinham ficado inativas por mais de uma hora. A ideia era reduzir o custo de retomar uma conversa depois que o cache já teria expirado. O problema foi a implementação: em vez de limpar o histórico uma vez, o sistema continuava limpando o raciocínio a cada turno pelo restante da sessão. O resultado era um agente que continuava executando tarefas, mas com cada vez menos memória do caminho que o levou até ali. A correção saiu em 10 de abril.

A terceira aconteceu em 16 de abril de 2026. Em preparação para o Opus 4.7, a Anthropic ajustou o harness e adicionou uma instrução no system prompt para reduzir verbosidade. A intenção era controlar respostas longas demais entre chamadas de ferramentas e nas respostas finais. Mas uma linha aparentemente simples no prompt teve efeito desproporcional na qualidade do código. A empresa reverteu a mudança em 20 de abril.

Segundo a Anthropic, os três problemas estavam resolvidos em 20 de abril, na versão v2.1.116 do Claude Code.

Essa linha do tempo importa porque ela explica por que o problema parecia confuso para quem estava usando o produto. Não foi uma única regressão clara, com um sintoma único e uma data única. Foram mudanças diferentes, afetando fatias diferentes de usuários, em momentos diferentes. Para quem estava do lado de fora, o efeito agregado parecia um produto instável: às vezes bom, às vezes distraído, às vezes lento, às vezes raso.

Por que tantos usuários sentiram queda de qualidade Link para o cabeçalho

Quando um agente de código piora, o usuário raramente enxerga a causa real. Ele não vê o parâmetro de raciocínio enviado para a API. Não vê quais blocos de contexto foram preservados. Não vê o prompt de sistema completo. Não vê a política de cache. Não sabe se está em um experimento, em uma versão nova ou em um caminho de execução específico.

O que ele vê é o comportamento.

E comportamento, em agentes, é uma soma de camadas. Se o agente esquece uma decisão tomada dez minutos antes, parece “menos inteligente”. Se ele escolhe uma ferramenta estranha, parece “menos confiável”. Se ele responde com menos contexto, parece “mais preguiçoso”. Se ele interrompe uma tarefa complexa com uma conclusão curta demais, parece que “não entendeu”. Mas cada uma dessas sensações pode vir de um ponto diferente da arquitetura.

Esse é um dos aprendizados mais importantes do episódio: qualidade de agente não é só benchmark de modelo.

Benchmarks ajudam, mas não capturam tudo. Um agente de programação trabalha em conversas longas, lê arquivos, roda comandos, acumula decisões, edita código, volta atrás, interpreta erros e precisa manter uma linha mental sobre o que está fazendo. Se o contexto é podado no momento errado, se a instrução de sistema estreita demais a resposta, se o modo de raciocínio padrão muda silenciosamente ou se o produto não deixa claro qual trade-off está em uso, o desempenho real cai mesmo que o modelo base continue excelente.

Para quem usa Codex, Claude Code, Cursor, Devin, Gemini CLI ou qualquer outro agente de desenvolvimento, isso muda a pergunta certa. Em vez de perguntar apenas “qual é o modelo mais inteligente?”, precisamos perguntar também:

- como o agente gerencia contexto?

- como ele preserva decisões anteriores?

- como ele verifica o próprio trabalho?

- como ele expõe trade-offs de velocidade, custo e profundidade?

- como ele lida com sessões longas?

- como o produto testa mudanças de prompt e comportamento?

O modelo importa muito. Mas o produto ao redor dele decide se essa inteligência chega inteira até o usuário.

O primeiro problema: reduzir o esforço de raciocínio Link para o cabeçalho

A primeira regressão descrita pela Anthropic nasceu de um dilema real: inteligência custa tempo.

Modelos modernos conseguem melhorar respostas quando recebem mais espaço para raciocinar, principalmente em tarefas de engenharia que exigem entender contexto, comparar alternativas e evitar mudanças perigosas. Mas esse raciocínio tem custo: mais latência, mais tokens e, em ferramentas interativas, maior risco de parecer que a interface travou.

No Claude Code, esse trade-off aparece nos níveis de effort. O usuário pode escolher entre respostas mais rápidas e respostas que pensam mais. O erro não foi oferecer um modo mais econômico. Isso é útil. O erro foi transformar esse modo no padrão para usuários que estavam usando a ferramenta justamente por sua capacidade de resolver problemas complexos.

E aqui existe uma lição de produto bem delicada: defaults são opiniões.

Quando uma ferramenta muda o padrão de high para medium, ela não está apenas mexendo em uma configuração. Ela está dizendo, implicitamente: “a experiência ideal deve priorizar menor latência”. Para alguns usuários, isso é perfeito. Para outros, especialmente em bases de código reais, a prioridade é outra: prefiro esperar mais se isso evita uma alteração ruim.

Quem trabalha com código sabe que uma resposta rápida e errada é mais cara do que uma resposta lenta e correta. O custo de revisar, desfazer, diagnosticar e recuperar confiança pode ser muito maior do que alguns segundos extras de espera.

A Anthropic reconheceu esse ponto. Depois do feedback, reverteu a mudança em 7 de abril e voltou a priorizar esforço maior por padrão. A decisão é um bom lembrete para qualquer produto de IA: não basta otimizar a média. É preciso entender qual tipo de erro o usuário tolera pior.

Em uma ferramenta de escrita casual, talvez latência seja o principal problema. Em um agente que altera código, mexe em arquivos e executa comandos, a queda de qualidade é mais corrosiva.

O segundo problema: cache, contexto e memória quebrada Link para o cabeçalho

O segundo problema é ainda mais interessante do ponto de vista técnico, porque ele mostra como uma otimização aparentemente razoável pode ferir uma propriedade essencial de agentes: continuidade.

Segundo a Anthropic, a mudança de 26 de março tentava reduzir custo e latência ao retomar sessões paradas por mais de uma hora. A lógica era: se o cache já expirou, talvez possamos limpar blocos antigos de raciocínio e enviar menos tokens na retomada. Em tese, depois disso, o sistema voltaria a preservar o histórico normalmente.

Mas o bug fez a limpeza acontecer repetidamente. Uma vez que a sessão passava pelo gatilho de inatividade, cada turno continuava descartando partes anteriores do raciocínio. O agente seguia trabalhando, mas sem ter acesso completo ao “por que” das próprias decisões.

Isso explica sintomas relatados por usuários: esquecimento, repetição e escolhas de ferramentas que pareciam estranhas. O agente podia lembrar do objetivo superficial, mas perdia o fio interno da execução. E, em programação, esse fio é decisivo.

Imagine uma sessão em que o agente lê três arquivos, descobre que uma função tem comportamento legado, decide fazer uma mudança mínima para preservar compatibilidade, roda um teste, encontra um erro, ajusta a abordagem e segue. Se parte do raciocínio anterior desaparece, a próxima ação pode parecer correta localmente, mas errada no fluxo inteiro. O agente deixa de agir como alguém que construiu entendimento progressivo e passa a agir como alguém que acordou no meio da tarefa com algumas anotações soltas na mesa.

Essa é uma diferença central entre chatbots e agentes. Um chatbot pode se recuperar com uma boa pergunta. Um agente no meio de uma edição precisa manter coerência operacional. Ele tem estado. Ele tem histórico. Ele tem uma trilha de decisões que precisa sobreviver ao tempo.

Também há uma lição sobre testes. A Anthropic afirmou que a mudança passou por revisões, testes unitários, testes de ponta a ponta, verificação automatizada e dogfooding. Ainda assim, escapou. Isso não significa que testes não funcionam. Significa que agentes criam estados compostos difíceis de reproduzir: sessão longa, idle, cache miss, uso de ferramenta, follow-up no meio do tool use, contexto parcialmente podado. O bug vivia no cruzamento dessas condições.

Para produtos baseados em agentes, testar o “caminho feliz” não basta. É preciso testar a vida real: sessão interrompida, retomada horas depois, contexto quase cheio, arquivos mudando, usuário corrigindo direção, comando falhando, agente alternando entre leitura e escrita.

O terceiro problema: quando um system prompt muda o comportamento do produto Link para o cabeçalho

O terceiro problema mostra uma verdade desconfortável para quem constrói sistemas com LLMs: prompt de sistema é código de produto.

Não no sentido romântico de “prompt engineering é a nova programação”, mas no sentido prático mesmo. Uma linha no system prompt pode alterar o comportamento do agente, mudar a qualidade de respostas, afetar o uso de ferramentas e introduzir regressão. Se essa linha entra em produção sem avaliação ampla, ela tem potencial de quebrar experiência.

A Anthropic adicionou uma instrução para reduzir verbosidade. A motivação era compreensível. Modelos mais capazes podem ficar mais longos, e respostas longas demais em um agente de código atrapalham: poluem o terminal, consomem tokens, tornam a conversa cansativa e podem esconder o que importa.

Mas existe uma diferença entre concisão e amputação.

Um agente de programação precisa ser econômico sem perder o raciocínio necessário. Em certos momentos, ele deve falar pouco: “rodei o teste, falhou em X, vou ajustar Y”. Em outros, ele precisa explicar riscos, trade-offs, efeitos colaterais e motivos para não tocar em determinado arquivo. Se o prompt empurra o agente para respostas curtas demais em todos os contextos, ele pode deixar de carregar informação que ajuda o próprio processo de resolução.

Esse ponto é especialmente importante porque system prompts não afetam apenas a resposta final. Eles moldam o comportamento entre chamadas de ferramenta, a forma de planejar, a disposição para explorar antes de editar e o quanto o agente explicita incertezas.

No postmortem, a Anthropic diz que ampliou ablations e avaliações por modelo para entender melhor o impacto de cada linha do prompt. Esse é o caminho correto. Prompt de sistema precisa de governança parecida com código sensível: revisão, teste, rollout gradual, telemetria, capacidade de rollback e entendimento por modelo.

Não é detalhe cosmético. É parte da arquitetura.

O que esse caso ensina sobre agentes de programação Link para o cabeçalho

O caso Claude Code ensina que agentes de programação são menos parecidos com “autocomplete turbinado” e mais parecidos com ambientes operacionais.

Eles precisam ler estado, escrever estado, preservar história, executar ações, pedir confirmação quando há risco, verificar resultados e corrigir curso. Isso exige engenharia em várias camadas:

- modelo forte o suficiente para entender código real;

- contexto bem gerenciado;

- prompts de sistema auditáveis;

- ferramentas confiáveis;

- permissões claras;

- logs e telemetria que capturem degradações sutis;

- avaliações que simulam fluxos longos;

- mecanismos de rollback;

- comunicação transparente quando algo dá errado.

Quando qualquer uma dessas camadas falha, o usuário costuma culpar “a IA”. E até faz sentido, porque para ele tudo aparece como um único personagem na tela. Mas, por baixo, há uma cadeia de componentes.

Esse é o ponto que muita discussão sobre agentes ainda ignora. Na prática, a vantagem não deve vir apenas do modelo mais inteligente, mas dos sistemas que combinam modelo, contexto, ferramenta e verificação com menos atrito.

O risco de confundir modelo, produto e experiência Link para o cabeçalho

Um detalhe importante do postmortem da Anthropic é a separação entre API e produto. A empresa afirmou que a API e a camada de inferência não foram afetadas. Os problemas estavam na experiência Claude Code e produtos relacionados.

Essa distinção é importante porque, no mercado, tudo se mistura muito rápido. Um usuário tem uma experiência ruim no agente e conclui que o modelo piorou. Outro usa a API diretamente e não vê o mesmo problema. Alguém compara relatos nas redes sociais e transforma sintomas diferentes em uma narrativa única: “o modelo foi nerfado”.

Às vezes, essa suspeita pode estar certa. Mas neste caso, segundo a própria Anthropic, a origem estava no produto.

Para equipes que usam IA em produção, isso sugere uma prática saudável: separar camadas na avaliação.

Quando algo piora, pergunte:

- o modelo mudou?

- o parâmetro de raciocínio mudou?

- o prompt de sistema mudou?

- a ferramenta mudou?

- a política de contexto mudou?

- o cache mudou?

- a interface mudou?

- o input do usuário mudou?

- o repositório ou ambiente mudou?

Sem essa separação, ficamos presos a diagnósticos emocionais. E diagnóstico emocional até pode dar um bom post no X, mas raramente corrige bug.

No trabalho real, precisamos de rastreabilidade. Versão do agente, versão do modelo, configuração de effort, logs de comando, diffs, testes, tamanho de contexto, fontes usadas e critérios de pronto. Quanto mais um agente atua sobre sistemas importantes, mais ele precisa deixar trilha.

O vazamento de código e a crise operacional em volta do Claude Code Link para o cabeçalho

No mesmo período, outro episódio aumentou a tensão em torno do Claude Code. Segundo uma reportagem da TechCrunch publicada em 1 de abril de 2026, a Anthropic teria deixado acidentalmente acessível o código-fonte do aplicativo Claude Code em uma versão recente. O código circulou no GitHub, e a empresa tentou remover cópias por meio de notificações de takedown.

O problema é que o takedown teria atingido cerca de 8.100 repositórios, incluindo forks legítimos do repositório público do Claude Code. De acordo com a reportagem, Boris Cherny, líder de Claude Code, afirmou que a medida foi acidental e que a Anthropic retirou a maior parte das notificações, mantendo a remoção apenas do repositório e dos forks que continham o código vazado.

Esse episódio é diferente do problema de qualidade descrito no postmortem, mas conversa com ele em um ponto: confiança operacional.

Ferramentas de agente de código vivem dentro do fluxo mais sensível de uma equipe: o repositório. Elas leem arquivos, sugerem alterações, executam comandos e participam da construção de software. Por isso, a expectativa de maturidade operacional é alta. Um vazamento de código seguido de takedowns amplos demais não afeta apenas a imagem da empresa. Ele reforça a pergunta que usuários técnicos sempre fazem: essa ferramenta é previsível o bastante para entrar no meu processo?

Não é uma pergunta hostil. É a pergunta correta.

Agentes de programação precisam ser avaliados não apenas pela demo brilhante, mas pela resposta a incidentes. Como comunicam? Como revertem? Como documentam? Como limitam dano? Como corrigem sem punir usuários legítimos? Como aprendem com o erro?

Nesse sentido, a transparência do postmortem de qualidade foi positiva. Mas o conjunto dos episódios mostra como a categoria ainda está amadurecendo. Estamos colocando agentes cada vez mais capazes em ambientes cada vez mais reais. A barra de governança precisa subir junto.

Lições práticas para quem usa Claude Code, Codex, Cursor ou outros agentes Link para o cabeçalho

A parte útil desse caso não é escolher um lado na torcida por ferramentas. É extrair práticas melhores para trabalhar com agentes.

A primeira lição: dê ao agente uma forma de verificar o próprio trabalho. A documentação de boas práticas do Claude Code enfatiza testes, screenshots, saídas esperadas e critérios de sucesso. Isso vale para qualquer ferramenta baseada em agentes. Se o agente pode rodar testes, comparar resultado e ver o erro, ele deixa de depender apenas da sua revisão manual.

A segunda: explore primeiro, planeje depois, implemente por último. Agentes tendem a parecer mais impressionantes quando saem editando. Mas, em bases reais, a ordem segura é outra: entender arquivos, identificar restrições, propor plano, confirmar e só então alterar. Essa disciplina reduz retrabalho e evita solução bonita para problema errado.

A terceira: gerencie contexto como recurso crítico. Contexto cheio, contexto velho, contexto podado ou contexto confuso pode degradar a resposta. Sessões longas devem ser resumidas, checkpoints devem ser claros e instruções importantes precisam estar em arquivos persistentes, como CLAUDE.md, AGENTS.md, skills locais ou docs de processo.

A quarta: trate prompts e configurações como parte do sistema. Se uma instrução muda comportamento, ela deve ser revisada. Se um default muda, isso deve ser comunicado. Se uma automação depende de um modo específico de raciocínio, isso precisa estar documentado.

A quinta: mantenha checkpoints humanos onde há risco. Um agente pode pesquisar, escrever, refatorar, testar e preparar commit. Mas publicar, remover arquivo, alterar histórico Git, mexer em credenciais ou trocar comportamento estrutural deve passar por aprovação explícita. Autonomia boa não é ausência de freio; é freio bem colocado.

A sexta: não confunda fluidez com qualidade. Um agente que responde rápido e com segurança pode estar errado. Um agente que demora e explica trade-offs pode estar salvando horas de retrabalho. A pergunta não é “ele parece inteligente?”, mas “ele consegue produzir resultado verificável, rastreável e reversível?”.

Essas práticas também ajudam a comparar ferramentas. Em vez de perguntar apenas qual agente “codifica melhor”, vale observar qual agente:

- preserva contexto por mais tempo;

- mostra o que está fazendo;

- respeita permissões;

- roda verificações;

- lida bem com erro;

- suporta instruções persistentes;

- aceita correções sem se perder;

- produz diffs pequenos e revisáveis;

- não transforma cada tarefa em uma aventura.

Essa última parece brincadeira, mas é engenharia.

Conclusão: agentes bons precisam de engenharia boa ao redor Link para o cabeçalho

O episódio recente do Claude Code é valioso porque tira a conversa do lugar comum.

Não foi apenas “modelo bom” contra “modelo ruim”. Foi um conjunto de decisões de produto: reduzir effort para diminuir latência, otimizar cache para economizar retomadas, ajustar system prompt para controlar verbosidade. Todas essas decisões tinham uma razão. Todas pareciam defensáveis isoladamente. Mas, no agregado, degradaram a experiência de parte dos usuários.

Esse é o desafio dos agentes modernos: eles são sistemas sensíveis a pequenos detalhes.

Um parâmetro muda a profundidade. Um cache muda a memória. Um prompt muda a postura. Um rollout muda quem sente o problema. Uma falha de comunicação muda a confiança. Uma resposta transparente ajuda a reconstruir parte dela.

Para usuários, a recomendação é prática: trate agentes como colaboradores poderosos, não como oráculos. Dê contexto, estabeleça critérios, exija verificação, preserve rastreabilidade e mantenha checkpoints em operações sensíveis.

Para quem constrói produtos baseados em agentes, a lição é ainda mais direta: inteligência de modelo não compensa fragilidade de sistema. O agente pode ser brilhante, mas se o produto ao redor corta seu raciocínio, apaga sua memória ou o instrui a falar menos quando deveria pensar melhor, a experiência final vai parecer burra.

No fim, agentes bons precisam de modelos bons. Mas também precisam de engenharia boa ao redor.

E talvez essa seja a fase mais interessante da IA aplicada: estamos saindo da pergunta “qual modelo responde melhor?” e entrando na pergunta mais adulta, mais difícil e mais útil: “qual sistema consegue transformar inteligência em trabalho confiável?”.

Referências Link para o cabeçalho

- Anthropic Engineering, “An update on recent Claude Code quality reports”, publicado em 23 de abril de 2026: https://www.anthropic.com/engineering/april-23-postmortem

- Claude Code Docs, “Best practices for Claude Code”: https://code.claude.com/docs/en/best-practices

- TechCrunch, “Anthropic took down thousands of GitHub repos trying to yank its leaked source code”, publicado em 1 de abril de 2026: https://techcrunch.com/2026/04/01/anthropic-took-down-thousands-of-github-repos-trying-to-yank-its-leaked-source-code-a-move-the-company-says-was-an-accident/

- GitHub DMCA, notice de 31 de março de 2026: https://github.com/github/dmca/blob/master/2026/03/2026-03-31-anthropic.md

- GitHub DMCA, retratação parcial de 1 de abril de 2026: https://github.com/github/dmca/blob/master/2026/04/2026-04-01-anthropic-retraction.md